问题描述

tf.nn.embedding_lookup(params, ids, partition_strategy='mod', name=None)这个函数有什么作用?看起来像查找表,也就是返回每个ID对应的参数(以ID为单位)?例如,在Skip-Gram模型中,如果我们使用tf.nn.embedding_lookup(embeddings, train_inputs),那么对于每个train_input,它会找到对应的嵌入(Embedding)?

简单来说

embedding_lookup函数检索params张量的行。该行为类似于对numpy中的数组使用索引。例如。

matrix = np.random.random([1024, 64]) # 64-dimensional embeddings

ids = np.array([0, 5, 17, 33])

print matrix[ids] # prints a matrix of shape [4, 64]

params参数也可以是张量的列表,在这种情况下,ids表示多个张量的索引组合。例如,给定ids:[0, 3],[1, 4],[2, 5],得到的张量都是[2, 64]的列表。

另外,partition_strategy参数可以控制ids在列表中的分配方式。当矩阵可能太大而无法合为一体时,分区策略对于较大规模的问题很有用。

进阶说明

最简单的形式类似于tf.gather。它根据ids指定的索引返回params的元素。

例如(假设您在tf.InteractiveSession()内)

params = tf.constant([10,20,30,40])

ids = tf.constant([0,1,2,3])

print tf.nn.embedding_lookup(params,ids).eval()

将返回[10 20 30 40],因为params的第一个元素(索引0)是10,params的第二个元素(索引1)是20,依此类推。

同样,

params = tf.constant([10,20,30,40])

ids = tf.constant([1,1,3])

print tf.nn.embedding_lookup(params,ids).eval()

将返回[20 20 40]。

但是embedding_lookup不仅限于此。 params参数可以是张量列表,而不是单个张量。

params1 = tf.constant([1,2])

params2 = tf.constant([10,20])

ids = tf.constant([2,0,2,1,2,3])

result = tf.nn.embedding_lookup([params1, params2], ids)

在这种情况下,在ids中指定的索引根据分区策略对应于张量的元素,其中默认分区策略为’mod’。

在’mod’策略中,索引0对应于列表中第一个张量的第一个元素。索引1对应于第二张量的第一元素。索引2对应于第三张量的第一个元素,依此类推。对于所有索引0..(n-1),假设参数是n张量的列表,则简单地将索引i对应于第(i + 1)张量的第一个元素。

现在,索引n不能对应于张量n + 1,因为列表params仅包含n张量。因此索引n对应于第一个张量的第二个元素。类似地,索引n+1对应于第二张量的第二个元素,依此类推。

因此,在代码中

params1 = tf.constant([1,2])

params2 = tf.constant([10,20])

ids = tf.constant([2,0,2,1,2,3])

result = tf.nn.embedding_lookup([params1, params2], ids)

下标0对应于第一个张量的第一个元素:1

索引1对应于第二张量的第一个元素:10

索引2对应于第一个张量的第二个元素:2

索引3对应于第二张量的第二个元素:20

因此,结果将是:

[ 2 1 2 10 2 20]

实际的例子

以文本嵌入(Embedding)为例,tf.nn.embedding_lookup()函数的目的是在嵌入矩阵中执行查找并返回单词的嵌入(或简单地说是矢量表示)。

一个简单的嵌入矩阵(形状:vocabulary_size x embedding_dimension)如下所示。 (即,每个单词将由一个数字向量表示;也就是word2vec)

嵌入矩阵

the 0.418 0.24968 -0.41242 0.1217 0.34527 -0.044457 -0.49688 -0.17862

like 0.36808 0.20834 -0.22319 0.046283 0.20098 0.27515 -0.77127 -0.76804

between 0.7503 0.71623 -0.27033 0.20059 -0.17008 0.68568 -0.061672 -0.054638

did 0.042523 -0.21172 0.044739 -0.19248 0.26224 0.0043991 -0.88195 0.55184

just 0.17698 0.065221 0.28548 -0.4243 0.7499 -0.14892 -0.66786 0.11788

national -1.1105 0.94945 -0.17078 0.93037 -0.2477 -0.70633 -0.8649 -0.56118

day 0.11626 0.53897 -0.39514 -0.26027 0.57706 -0.79198 -0.88374 0.30119

country -0.13531 0.15485 -0.07309 0.034013 -0.054457 -0.20541 -0.60086 -0.22407

under 0.13721 -0.295 -0.05916 -0.59235 0.02301 0.21884 -0.34254 -0.70213

such 0.61012 0.33512 -0.53499 0.36139 -0.39866 0.70627 -0.18699 -0.77246

second -0.29809 0.28069 0.087102 0.54455 0.70003 0.44778 -0.72565 0.62309

我拆分了上述嵌入矩阵,并仅将单词vocab装入我们的词汇表,并将相应的向量装入emb数组。

vocab = ['the','like','between','did','just','national','day','country','under','such','second']

emb = np.array([[0.418, 0.24968, -0.41242, 0.1217, 0.34527, -0.044457, -0.49688, -0.17862],

[0.36808, 0.20834, -0.22319, 0.046283, 0.20098, 0.27515, -0.77127, -0.76804],

[0.7503, 0.71623, -0.27033, 0.20059, -0.17008, 0.68568, -0.061672, -0.054638],

[0.042523, -0.21172, 0.044739, -0.19248, 0.26224, 0.0043991, -0.88195, 0.55184],

[0.17698, 0.065221, 0.28548, -0.4243, 0.7499, -0.14892, -0.66786, 0.11788],

[-1.1105, 0.94945, -0.17078, 0.93037, -0.2477, -0.70633, -0.8649, -0.56118],

[0.11626, 0.53897, -0.39514, -0.26027, 0.57706, -0.79198, -0.88374, 0.30119],

[-0.13531, 0.15485, -0.07309, 0.034013, -0.054457, -0.20541, -0.60086, -0.22407],

[ 0.13721, -0.295, -0.05916, -0.59235, 0.02301, 0.21884, -0.34254, -0.70213],

[ 0.61012, 0.33512, -0.53499, 0.36139, -0.39866, 0.70627, -0.18699, -0.77246 ],

[ -0.29809, 0.28069, 0.087102, 0.54455, 0.70003, 0.44778, -0.72565, 0.62309 ]])

emb.shape

# (11, 8)

在TensorFlow中查找嵌入(Embedding)

现在,我们将看到如何对某些任意输入语句执行嵌入查找。

In [54]: from collections import OrderedDict

# embedding as TF tensor (for now constant; could be tf.Variable() during training)

In [55]: tf_embedding = tf.constant(emb, dtype=tf.float32)

# input for which we need the embedding

In [56]: input_str = "like the country"

# build index based on our `vocabulary`

In [57]: word_to_idx = OrderedDict({w:vocab.index(w) for w in input_str.split() if w in vocab})

# lookup in embedding matrix & return the vectors for the input words

In [58]: tf.nn.embedding_lookup(tf_embedding, list(word_to_idx.values())).eval()

Out[58]:

array([[ 0.36807999, 0.20834 , -0.22318999, 0.046283 , 0.20097999,

0.27515 , -0.77126998, -0.76804 ],

[ 0.41800001, 0.24968 , -0.41242 , 0.1217 , 0.34527001,

-0.044457 , -0.49687999, -0.17862 ],

[-0.13530999, 0.15485001, -0.07309 , 0.034013 , -0.054457 ,

-0.20541 , -0.60086 , -0.22407 ]], dtype=float32)

观察我们如何使用词汇表中的单词索引从原始嵌入矩阵(带单词)中获取嵌入。

通常,此类嵌入查找是由第一层(称为嵌入层)执行的,然后将这些嵌入传递到RNN /LSTM /GRU层以进行进一步处理。

旁注:通常,词汇表还将具有特殊的unk token。因此,如果我们的词汇表中不存在来自我们输入句子的token,那么将在嵌入矩阵中查找与unk对应的索引。

附言请注意,embedding_dimension是一个超参数,必须针对其应用进行调整,但是流行的模型(如Word2Vec和GloVe)使用300维向量来表示每个单词。

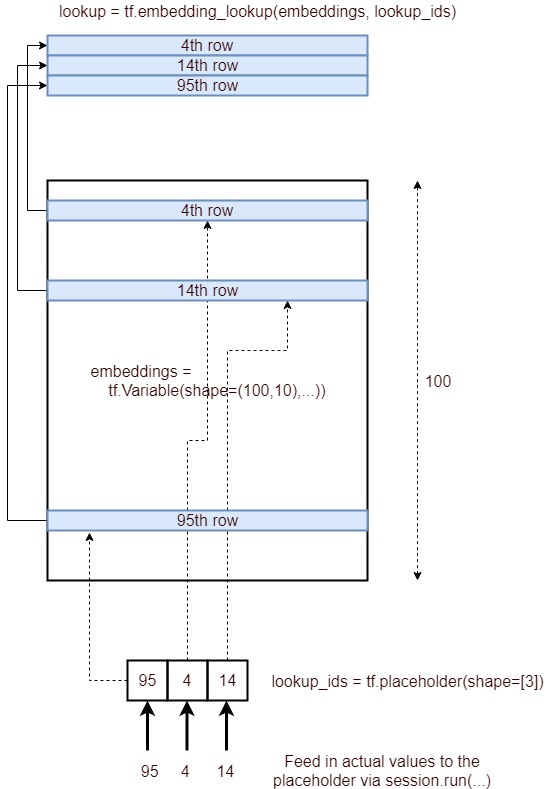

嵌入的图示

这是描述嵌入查找过程的图示。

简而言之,它获取由ID列表指定的嵌入层的相应行,并将其提供为张量。它是通过以下过程实现的。

- 定义一个占位符

lookup_ids = tf.placeholder([10]) - 定义嵌入层

embeddings = tf.Variable([100,10],...) - 定义张量流操作

embed_lookup = tf.embedding_lookup(embeddings, lookup_ids) - 通过运行

lookup = session.run(embed_lookup, feed_dict={lookup_ids:[95,4,14]})获取结果

高维embedding_lookup例子

当参数张量为高维时,id仅指最大维。也许对大多数人来说很明显,但是我必须运行以下代码才能理解这一点:

embeddings = tf.constant([[[1,1],[2,2],[3,3],[4,4]],[[11,11],[12,12],[13,13],[14,14]],

[[21,21],[22,22],[23,23],[24,24]]])

ids=tf.constant([0,2,1])

embed = tf.nn.embedding_lookup(embeddings, ids, partition_strategy='div')

with tf.Session() as session:

result = session.run(embed)

print (result)

仅尝试’div’策略,对于一个张量,这没有什么区别。

这是输出:

[[[ 1 1]

[ 2 2]

[ 3 3]

[ 4 4]]

[[21 21]

[22 22]

[23 23]

[24 24]]

[[11 11]

[12 12]

[13 13]

[14 14]]]

参考资料