本文简要介绍python语言中 torch.nn.Softplus 的用法。

用法:

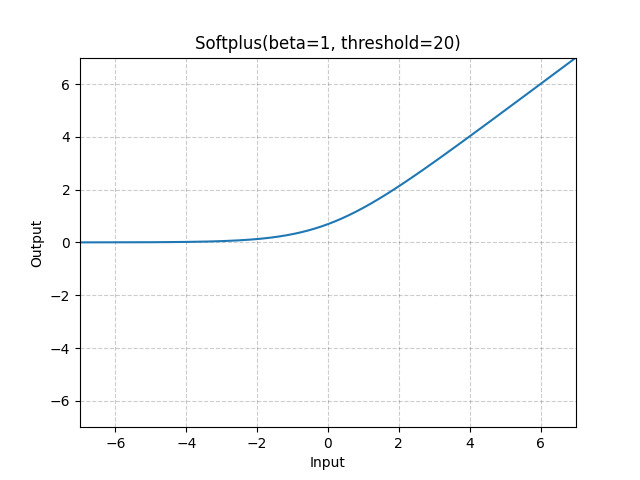

class torch.nn.Softplus(beta=1, threshold=20)beta-Softplus 配方的 值。默认值:1

threshold-高于此值的值恢复为线性函数。默认值:20

应用逐元素函数:

SoftPlus 是ReLU 函数的平滑近似,可用于将机器的输出约束为始终为正。

为了数值稳定性,实现在 时恢复为线性函数。

- 形状:

输入: ,其中 表示任意数量的维度。

输出:,与输入的形状相同。

例子:

>>> m = nn.Softplus() >>> input = torch.randn(2) >>> output = m(input)

参数:

相关用法

- Python PyTorch Softmin用法及代码示例

- Python PyTorch Softmax2d用法及代码示例

- Python PyTorch Softshrink用法及代码示例

- Python PyTorch Softmax用法及代码示例

- Python PyTorch Softsign用法及代码示例

- Python PyTorch SobolEngine用法及代码示例

- Python PyTorch ScaledDotProduct.__init__用法及代码示例

- Python PyTorch Sigmoid用法及代码示例

- Python PyTorch ShardedEmbeddingBagCollection.named_parameters用法及代码示例

- Python PyTorch SummaryWriter.add_histogram用法及代码示例

- Python PyTorch ScriptModule.state_dict用法及代码示例

- Python PyTorch SummaryWriter.add_pr_curve用法及代码示例

- Python PyTorch ShardedEmbeddingBag.named_parameters用法及代码示例

- Python PyTorch ScriptModule.register_full_backward_hook用法及代码示例

- Python PyTorch SummaryWriter.add_custom_scalars用法及代码示例

- Python PyTorch ScriptModule.parameters用法及代码示例

- Python PyTorch ShardedEmbeddingBag.state_dict用法及代码示例

- Python PyTorch SummaryWriter.add_image用法及代码示例

- Python PyTorch Store.num_keys用法及代码示例

- Python PyTorch ShardedEmbeddingBagCollection.named_modules用法及代码示例

- Python PyTorch SummaryWriter.add_hparams用法及代码示例

- Python PyTorch ScriptModule.register_forward_hook用法及代码示例

- Python PyTorch ShardedEmbeddingBagCollection.state_dict用法及代码示例

- Python PyTorch ScriptModule.modules用法及代码示例

- Python PyTorch SummaryWriter.__init__用法及代码示例

注:本文由纯净天空筛选整理自pytorch.org大神的英文原创作品 torch.nn.Softplus。非经特殊声明,原始代码版权归原作者所有,本译文未经允许或授权,请勿转载或复制。