本文簡要介紹python語言中 torch.nn.PReLU 的用法。

用法:

class torch.nn.PReLU(num_parameters=1, init=0.25, device=None, dtype=None)~PReLU.weight(Tensor) -形狀的可學習權重(

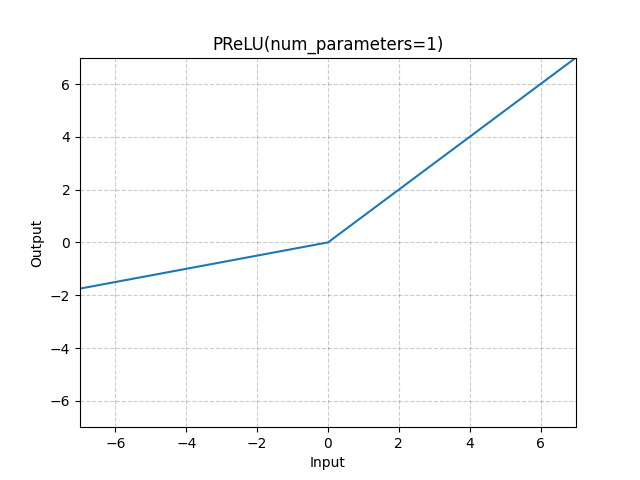

num_parameters)。應用逐元素函數:

或者

這裏 是一個可學習的參數。當不帶參數調用時,

nn.PReLU()在所有輸入通道中使用單個參數 。如果使用nn.PReLU(nChannels)調用,則每個輸入通道使用單獨的 。注意

在學習 以獲得良好性能時,不應使用權重衰減。

注意

通道 dim 是輸入的第二個 dim。當輸入的 dims < 2 時,則沒有通道 dim 並且通道數 = 1。

- 形狀:

輸入: 其中

*表示任意數量的附加維度。輸出:,與輸入的形狀相同。

例子:

>>> m = nn.PReLU() >>> input = torch.randn(2) >>> output = m(input)

參數:

變量:

相關用法

- Python PyTorch PackageImporter.id用法及代碼示例

- Python PyTorch Proxy用法及代碼示例

- Python PyTorch PoissonNLLLoss用法及代碼示例

- Python PyTorch PixelShuffle用法及代碼示例

- Python PyTorch Pipe用法及代碼示例

- Python PyTorch ParagraphAggregator用法及代碼示例

- Python PyTorch PooledEmbeddingsAllToAll用法及代碼示例

- Python PyTorch PackageExporter.register_extern_hook用法及代碼示例

- Python PyTorch Poisson用法及代碼示例

- Python PyTorch Perceptron用法及代碼示例

- Python PyTorch ParallelReadConcat用法及代碼示例

- Python PyTorch ParameterList用法及代碼示例

- Python PyTorch PairwiseDistance用法及代碼示例

- Python PyTorch ParquetDataFrameLoader用法及代碼示例

- Python PyTorch PackageExporter.register_intern_hook用法及代碼示例

- Python PyTorch PixelUnshuffle用法及代碼示例

- Python PyTorch ParameterDict用法及代碼示例

- Python PyTorch PitchShift用法及代碼示例

- Python PyTorch Pareto用法及代碼示例

- Python PyTorch PackageExporter.close用法及代碼示例

- Python PyTorch PooledEmbeddingsReduceScatter用法及代碼示例

- Python PyTorch PackageExporter.register_mock_hook用法及代碼示例

- Python PyTorch frexp用法及代碼示例

- Python PyTorch jvp用法及代碼示例

- Python PyTorch cholesky用法及代碼示例

注:本文由純淨天空篩選整理自pytorch.org大神的英文原創作品 torch.nn.PReLU。非經特殊聲明,原始代碼版權歸原作者所有,本譯文未經允許或授權,請勿轉載或複製。