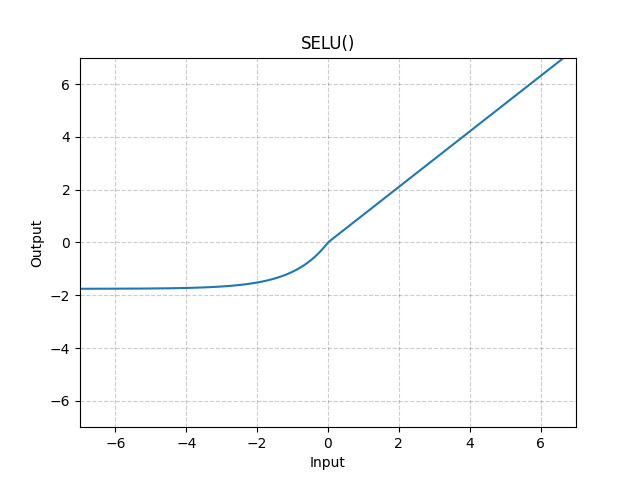

本文簡要介紹python語言中 torch.nn.SELU 的用法。

用法:

class torch.nn.SELU(inplace=False)inplace(bool,可選的) -可以選擇就地執行操作。默認值:

False按元素應用,如:

與 和 。

警告

使用

kaiming_normal或kaiming_normal_進行初始化時,應使用nonlinearity='linear'而不是nonlinearity='selu'以獲得 Self-Normalizing Neural Networks 。有關詳細信息,請參閱torch.nn.init.calculate_gain()。更多細節可以在論文Self-Normalizing Neural Networks 中找到。

- 形狀:

輸入: ,其中 表示任意數量的維度。

輸出:,與輸入的形狀相同。

例子:

>>> m = nn.SELU() >>> input = torch.randn(2) >>> output = m(input)

參數:

相關用法

- Python PyTorch ScaledDotProduct.__init__用法及代碼示例

- Python PyTorch Sigmoid用法及代碼示例

- Python PyTorch ShardedEmbeddingBagCollection.named_parameters用法及代碼示例

- Python PyTorch SummaryWriter.add_histogram用法及代碼示例

- Python PyTorch ScriptModule.state_dict用法及代碼示例

- Python PyTorch Softmin用法及代碼示例

- Python PyTorch SummaryWriter.add_pr_curve用法及代碼示例

- Python PyTorch Softmax2d用法及代碼示例

- Python PyTorch ShardedEmbeddingBag.named_parameters用法及代碼示例

- Python PyTorch ScriptModule.register_full_backward_hook用法及代碼示例

- Python PyTorch SummaryWriter.add_custom_scalars用法及代碼示例

- Python PyTorch ScriptModule.parameters用法及代碼示例

- Python PyTorch ShardedEmbeddingBag.state_dict用法及代碼示例

- Python PyTorch SummaryWriter.add_image用法及代碼示例

- Python PyTorch Store.num_keys用法及代碼示例

- Python PyTorch ShardedEmbeddingBagCollection.named_modules用法及代碼示例

- Python PyTorch SummaryWriter.add_hparams用法及代碼示例

- Python PyTorch ScriptModule.register_forward_hook用法及代碼示例

- Python PyTorch ShardedEmbeddingBagCollection.state_dict用法及代碼示例

- Python PyTorch ScriptModule.modules用法及代碼示例

- Python PyTorch SummaryWriter.__init__用法及代碼示例

- Python PyTorch SparseArch用法及代碼示例

- Python PyTorch SequentialLR用法及代碼示例

- Python PyTorch ShardedEmbeddingCollection.named_parameters用法及代碼示例

- Python PyTorch ScriptModule.register_forward_pre_hook用法及代碼示例

注:本文由純淨天空篩選整理自pytorch.org大神的英文原創作品 torch.nn.SELU。非經特殊聲明,原始代碼版權歸原作者所有,本譯文未經允許或授權,請勿轉載或複製。